Inferless

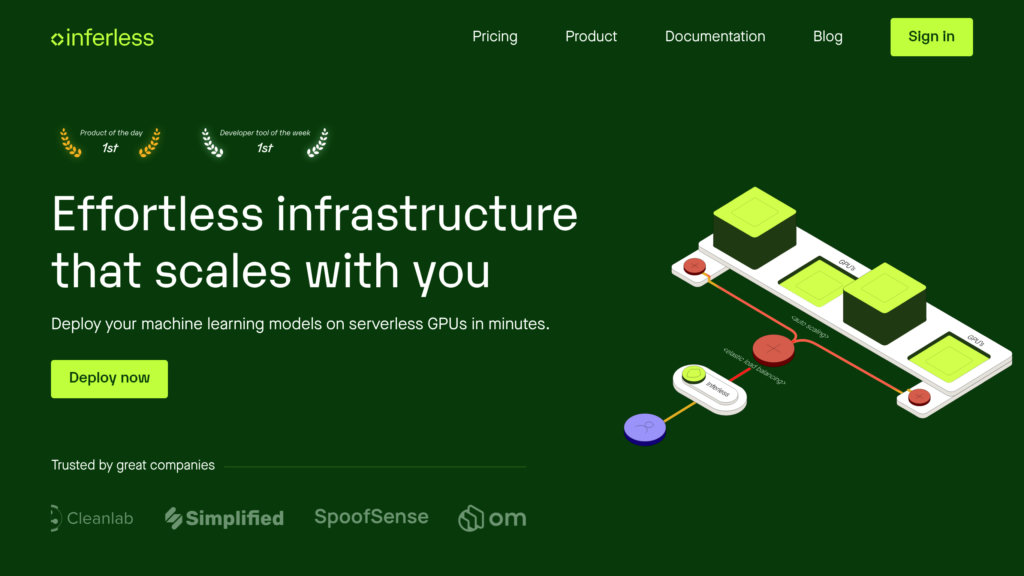

Serverless GPU 平台,實現快速、可擴展且高成本效益的自訂機器學習模型部署,自動擴展並具備低延遲。

社群:

產品概覽

Inferless 是什麼?

Inferless 是一個先進的 Serverless GPU 推論平台,專為簡化與優化機器學習模型的部署而設計。開發者可輕鬆從 Hugging Face、Git、Docker 等來源部署模型,僅需最少設定,即可彈性擴展至數百張 GPU。透過基於基礎架構感知的負載平衡與動態批次處理,Inferless 最大化 GPU 使用率,將冷啟動延遲降至數秒,並提供自動化 CI/CD 管線。其安全隔離的執行環境與可自訂的運行時,適用於各式 AI 工作負載,包括 LLM 聊天機器人、電腦視覺與音訊生成,是大規模生產等級 ML 推論的理想選擇。

主要功能

Serverless GPU 自動擴展

根據即時需求自動調整 GPU 資源,確保成本效益與穩定效能,即使面對突發工作負載也能應對自如。

動態批次處理

在伺服器端將多個推論請求合併為單一批次,以最佳化 GPU 吞吐量並降低延遲。

自訂執行環境支援

允許用戶根據模型需求,自行定義具有特定軟體依賴的容器環境。

自動化 CI/CD 整合

啟用自動模型重建與部署,免除手動操作,加速開發流程。

類 NFS 可寫磁碟卷

支援多個副本同時連線,有效進行資料共享與儲存。

全方位監控與日誌

提供詳細的呼叫與建置日誌、效能指標,並區分推論與建置日誌,方便除錯與優化。

使用案例

- 大型語言模型(LLM)聊天機器人 : 以先進語言模型部署具擴展性與即時回應的聊天機器人,實現極低延遲。

- AI Agent 與自動化 : 運行 AI 驅動的 Agent,動態擴展以高效處理不可預期的工作負載。

- 電腦視覺應用 : 部署影像與影片分析模型,透過最佳化 GPU 推論實現即時處理。

- 音訊生成與處理 : 支援音訊合成與處理模型,彈性擴展 GPU 資源以滿足需求。

- 批次處理工作負載 : 動態分配資源,有效處理大規模批次推論任務。

常見問題

Inferless 的替代方案

Not Diamond

AI meta-model 路由器,能智慧選擇每筆查詢最適合的 LLM,提升品質、降低成本並減少延遲。

Predibase

新一代 AI 平台,專注於高速微調與部署開源小型語言模型,兼具極速與高性價比。

Unify AI

一個透過統一API和動態路由簡化大型語言模型存取、比較和最佳化的平台。

Cerebrium

無伺服器AI基礎設施平台,實現AI模型的快速、可擴展部署和管理,優化效能和成本效率。

TokenCounter

多模型瀏覽器端 Token 計算與費用預估工具。

Cirrascale Cloud Services

高效能雲端平台,提供可擴展的GPU加速運算和儲存,為AI、HPC和生成式工作負載進行了優化。

TrainLoop AI

以強化學習微調推理模型,提供領域專屬且可靠AI效能的託管平台。

PPIO派欧云

分散式雲計算平台,為AI、多媒體和元宇宙應用提供高效能計算資源、模型服務和邊緣計算。

Inferless 網站分析

🇺🇸 US: 22.27%

🇮🇳 IN: 13.14%

🇻🇳 VN: 8.51%

🇹🇷 TR: 7.18%

🇧🇷 BR: 5.02%

Others: 43.88%