產品概覽

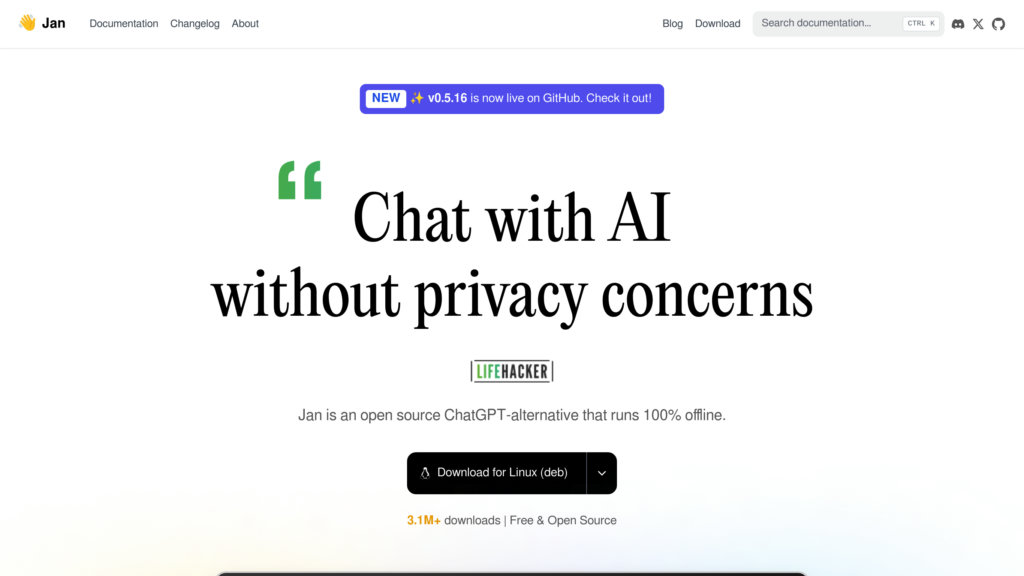

Jan 是什麼?

Jan 是一款跨平台、開源的 AI 助理,設計上可於本地裝置直接運行大型語言模型,確保資料隱私與用戶自主權。支援像 Llama、Mistral 等模型於本機離線運作,無需將資料傳送至外部伺服器。Jan 亦可整合 OpenAI、Anthropic 等雲端 AI API,讓有需要時功能更強大。模組化架構讓用戶能透過擴充套件與可程式化 API 深度自訂 AI 行為,非常適合重視隱私的一般用戶與開發者。

主要功能

本機優先 AI 處理

AI 模型完全在你的裝置上離線運行,所有資料皆保留於本地,確保隱私與安全,無需依賴雲端伺服器。

雲端 AI 整合

可選擇連接如 OpenAI GPT-4、Anthropic Claude 等雲端 AI 服務,擴充 AI 能力與功能。

跨平台相容性

支援 Windows、macOS 與 Linux,並針對多種硬體(如 NVIDIA GPU、Apple Silicon)最佳化。

可擴充模組化擴充功能

可透過擴充套件自訂並強化功能,加入新的 AI 引擎、工具與整合。

OpenAI 相容本地 API 伺服器

提供相容 OpenAI 標準的本地 API,可與第三方應用程式與自動化流程整合。

用戶資料自主與隱私

所有對話與檔案皆以通用格式儲存在本地,Jan 不會蒐集或販售任何資料。

使用案例

- 重視隱私的 AI 協助 : 需要 AI 協助但不想將資料暴露給雲端供應商的用戶,可完全離線運行模型。

- 開發者自訂 AI 解決方案 : 開發者可透過 Jan 的 API 與擴充套件,打造並整合自訂 AI 工作流程。

- 多模型 AI 實驗 : 在單一介面中體驗各種開源與雲端 AI 模型,方便實驗與比較。

- AI 驅動內容創作 : 利用可自訂的 AI 助理產生文本、激發創意、或自動化各種任務。

- 適用於離線或高隱私需求環境的 AI : 在無網路或高度重視資料隱私的環境下也能運作 AI 工具。

常見問題

Jan 的替代方案

Fluidstack

雲端平台提供快速、大規模的GPU基礎設施,用於AI模型訓練和推論,受到領先AI實驗室和企業的信賴。

GMI Cloud

一個推論優先的GPU雲端平台,結合serverless推論和專用GPU基礎設施,用於生產AI工作負載,基於NVIDIA硬體建構。

Cerebrium

無伺服器AI基礎設施平台,實現AI模型的快速、可擴展部署和管理,優化效能和成本效率。

LiteLLM

開源 LLM Gateway,透過標準化 OpenAI 相容介面,統一存取 100+ 語言模型。

FuriosaAI

專為數據中心中可擴展推論設計的高效能、低功耗AI加速器,針對大型語言模型和多模態工作負載進行最佳化。

Not Diamond

AI meta-model 路由器,能智慧選擇每筆查詢最適合的 LLM,提升品質、降低成本並減少延遲。

Inferless

Serverless GPU 平台,實現快速、可擴展且高成本效益的自訂機器學習模型部署,自動擴展並具備低延遲。

Unify AI

一個透過統一API和動態路由簡化大型語言模型存取、比較和最佳化的平台。

Jan 網站分析

🇺🇸 US: 16.49%

🇮🇳 IN: 8.06%

🇩🇪 DE: 4.82%

🇧🇷 BR: 4.01%

🇨🇳 CN: 3.58%

Others: 63.04%