TokenCounter

Outil de comptage de jetons et d'estimation des coûts basé sur le navigateur pour plusieurs modèles de langage de grande taille (LLMs) populaires.

Communauté:

Aperçu du produit

Qu'est-ce que TokenCounter ?

TokenCounter est un outil sophistiqué et axé sur la confidentialité, conçu pour compter précisément les jetons et estimer les coûts d'utilisation pour une large gamme de LLMs largement utilisés comme GPT-4, Claude-3, Llama-3, etc. Il fonctionne entièrement côté client dans le navigateur grâce à des tokenizers performants de la bibliothèque Transformers.js, garantissant que les données des prompts ne quittent jamais l'appareil de l'utilisateur. Cela permet aux développeurs, chercheurs et utilisateurs d'IA d'optimiser la longueur des prompts, de gérer les budgets et d'éviter les erreurs de limite de jetons efficacement, sans compromettre la confidentialité des données.

Fonctionnalités clés

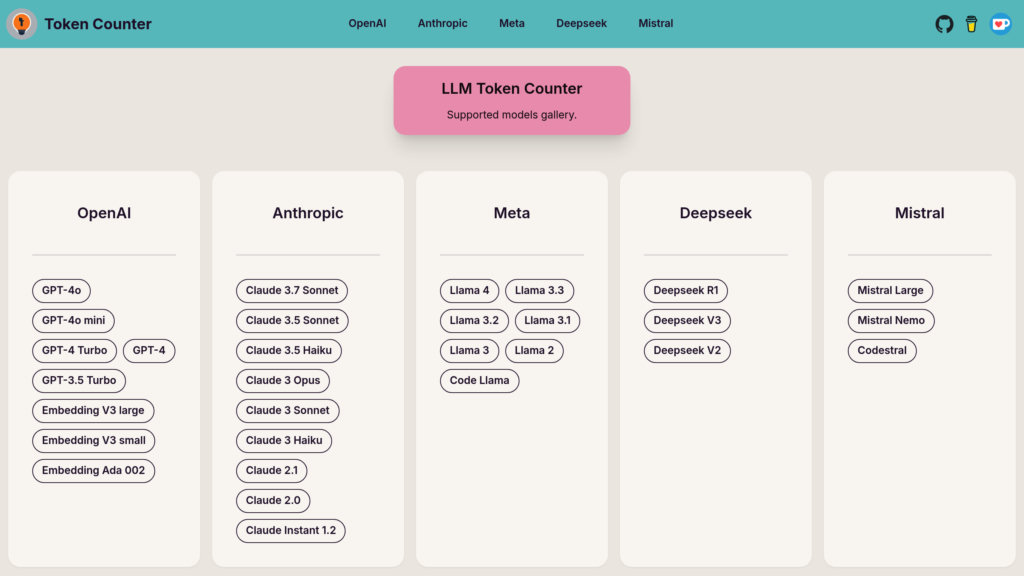

Comptage de jetons multi-modèles

Prend en charge la tokenisation pour de nombreux LLMs populaires, y compris OpenAI, Anthropic, Meta et plus encore, fournissant des comptes de jetons précis adaptés au tokenizer spécifique de chaque modèle.

Confidentialité côté client

Effectue tous les calculs de jetons localement dans le navigateur, garantissant que les invites des utilisateurs restent confidentielles et ne sont transmises à aucun serveur.

Estimation en temps réel des jetons et des coûts

Affiche instantanément le nombre de jetons et estime les coûts d'entrée à mesure que les utilisateurs saisissent ou collent du texte, permettant une optimisation efficace des prompts.

Basé sur le navigateur et facile à utiliser

Aucune installation requise ; fonctionne entièrement dans le navigateur avec une interface conviviale adaptée aussi bien aux débutants qu'aux experts.

Extension continue du support des modèles

Mise à jour régulière pour inclure davantage de LLMs et améliorer la précision du comptage des jetons, reflétant l'évolution du secteur de l'IA.

Cas d'utilisation

- Optimisation des prompts : Aide les développeurs et utilisateurs d'IA à adapter les prompts pour respecter les limites de jetons afin d'éviter les erreurs et réduire les coûts inutiles.

- Gestion des coûts : Permet de budgétiser et d'estimer les coûts d'utilisation des API en calculant les jetons et en estimant les dépenses avant d'envoyer les requêtes.

- Recherche et développement : Soutient les chercheurs en IA dans l'analyse des schémas d'utilisation des jetons sur différents modèles pour des études expérimentales et comparatives.

- Outil pédagogique : Aide les apprenants et passionnés d'IA à comprendre la tokenisation et les limites de jetons propres à chaque modèle grâce à une interaction pratique.

FAQ

Alternatives à TokenCounter

Fluidstack

Plateforme cloud fournissant une infrastructure GPU rapide et à grande échelle pour l'entraînement et l'inférence de modèles d'IA, faisant confiance aux principaux laboratoires et entreprises d'IA.

GMI Cloud

Une plateforme cloud GPU axée sur l'inférence combinant inférence serverless et infrastructure GPU dédiée pour les charges de travail IA de production, construite sur le matériel NVIDIA.

FuriosaAI

Accélérateurs d'IA haute performance et économes en énergie conçus pour l'inférence évolutive dans les centres de données, optimisés pour les grands modèles de langage et les charges de travail multimodales.

Cerebrium

Plateforme d'infrastructure d'IA sans serveur permettant un déploiement et une gestion rapides et évolutifs des modèles d'IA avec des performances et une efficacité de coûts optimisées.

Jan

Assistant IA open-source axé sur la confidentialité, exécutant des modèles locaux et cloud avec de larges possibilités de personnalisation et des capacités hors ligne.

Inferless

Plateforme GPU serverless permettant un déploiement rapide, évolutif et économique de modèles de machine learning personnalisés avec autoscaling automatique et faible latence.

Not Diamond

Routeur IA méta-modèle qui sélectionne intelligemment le meilleur grand modèle de langage (LLM) pour chaque requête afin de maximiser la qualité, réduire les coûts et minimiser la latence.

Cirrascale Cloud Services

Plateforme cloud haute performance offrant un calcul et un stockage évolutifs accélérés par GPU, optimisés pour les charges de travail d'IA, de HPC et génératif.

Analytiques du site TokenCounter

Others: 100%