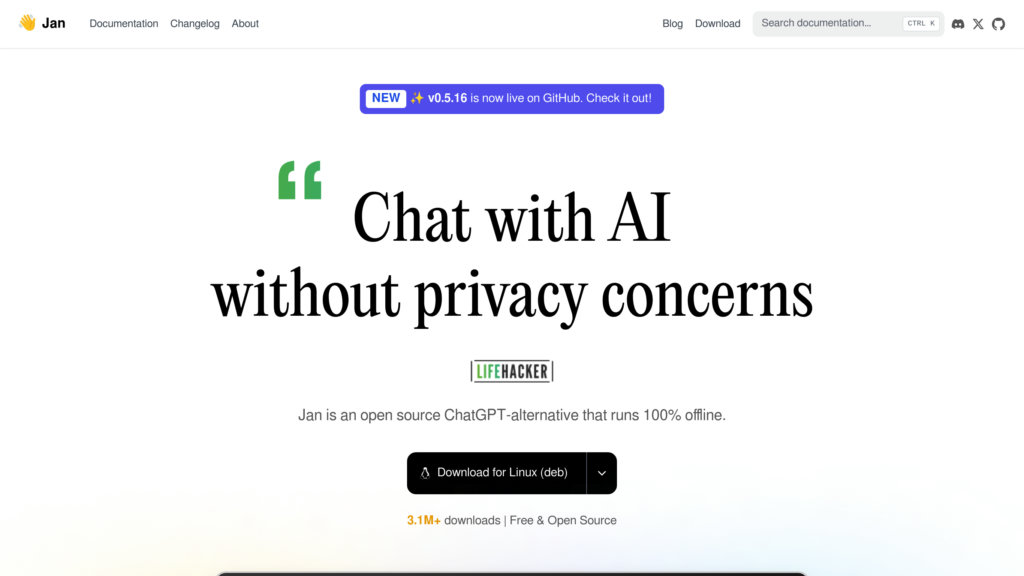

Jan

Assistant IA open-source axé sur la confidentialité, exécutant des modèles locaux et cloud avec de larges possibilités de personnalisation et des capacités hors ligne.

Communauté:

Aperçu du produit

Qu'est-ce que Jan ?

Jan est un assistant IA open-source, multi-plateforme, conçu pour exécuter de grands modèles de langage localement sur votre appareil, garantissant une confidentialité totale des données et un contrôle utilisateur. Il fonctionne hors ligne en exécutant des modèles IA comme Llama, Mistral et d'autres directement sur votre ordinateur sans envoyer de données à des serveurs externes. Jan s'intègre aussi avec des API cloud IA telles qu'OpenAI et Anthropic pour des capacités accrues si besoin. Son architecture modulaire permet aux utilisateurs de personnaliser le comportement de l'IA via des extensions et des API programmables, le rendant adapté aussi bien aux utilisateurs occasionnels qu'aux développeurs recherchant une solution IA axée sur la confidentialité.

Fonctionnalités clés

Traitement IA Local-First

Exécute les modèles d'IA entièrement hors ligne sur votre appareil, gardant toutes les données privées et sécurisées sans dépendre de serveurs cloud.

Intégration Cloud AI

Connectez-vous en option à des services d'IA cloud comme OpenAI GPT-4 et Anthropic Claude pour plus de puissance et de fonctionnalités.

Compatibilité Multi-plateforme

Compatible avec Windows, macOS et Linux, optimisé pour différents matériels, y compris les GPU NVIDIA et Apple Silicon.

Extensible avec Extensions Modulaires

Personnalisez et améliorez les fonctionnalités avec des extensions ajoutant de nouveaux moteurs IA, outils et intégrations.

Serveur API Local Compatible OpenAI

Fournit une API locale compatible avec les standards OpenAI, permettant l'intégration avec des applications tierces et des flux de travail.

Propriété et Confidentialité des Données Utilisateur

Toutes les conversations et fichiers sont stockés localement dans des formats universels, sans collecte ni vente de données par Jan.

Cas d'utilisation

- Assistance IA Respectueuse de la Vie Privée : Les utilisateurs ayant besoin d'aide IA sans exposer leurs données aux fournisseurs cloud peuvent exécuter les modèles entièrement hors ligne.

- Solutions IA Personnalisées pour Développeurs : Les développeurs peuvent créer et intégrer des flux de travail IA personnalisés en utilisant l'API et les extensions de Jan.

- Expérimentation Multi-modèle IA : Expérimentez avec divers modèles IA open-source et cloud dans une interface unifiée.

- Création de Contenu Assistée par IA : Générez du texte, trouvez des idées et automatisez des tâches avec des assistants IA personnalisables.

- IA Hors Ligne pour Environnements Sécurisés ou Isolés : Utilisez des outils IA dans des environnements sans accès internet ou lorsque la confidentialité est cruciale.

FAQ

Alternatives à Jan

GMI Cloud

Une plateforme cloud GPU axée sur l'inférence combinant inférence serverless et infrastructure GPU dédiée pour les charges de travail IA de production, construite sur le matériel NVIDIA.

Fluidstack

Plateforme cloud fournissant une infrastructure GPU rapide et à grande échelle pour l'entraînement et l'inférence de modèles d'IA, faisant confiance aux principaux laboratoires et entreprises d'IA.

FuriosaAI

Accélérateurs d'IA haute performance et économes en énergie conçus pour l'inférence évolutive dans les centres de données, optimisés pour les grands modèles de langage et les charges de travail multimodales.

Cerebrium

Plateforme d'infrastructure d'IA sans serveur permettant un déploiement et une gestion rapides et évolutifs des modèles d'IA avec des performances et une efficacité de coûts optimisées.

LiteLLM

Passerelle LLM open-source offrant un accès unifié à plus de 100 modèles linguistiques via une interface standardisée compatible OpenAI.

Inferless

Plateforme GPU serverless permettant un déploiement rapide, évolutif et économique de modèles de machine learning personnalisés avec autoscaling automatique et faible latence.

Cirrascale Cloud Services

Plateforme cloud haute performance offrant un calcul et un stockage évolutifs accélérés par GPU, optimisés pour les charges de travail d'IA, de HPC et génératif.

Not Diamond

Routeur IA méta-modèle qui sélectionne intelligemment le meilleur grand modèle de langage (LLM) pour chaque requête afin de maximiser la qualité, réduire les coûts et minimiser la latence.

Analytiques du site Jan

🇺🇸 US: 17.92%

🇩🇪 DE: 8.26%

🇮🇳 IN: 5.85%

🇷🇺 RU: 3.94%

🇳🇱 NL: 3.41%

Others: 60.62%