产品概览

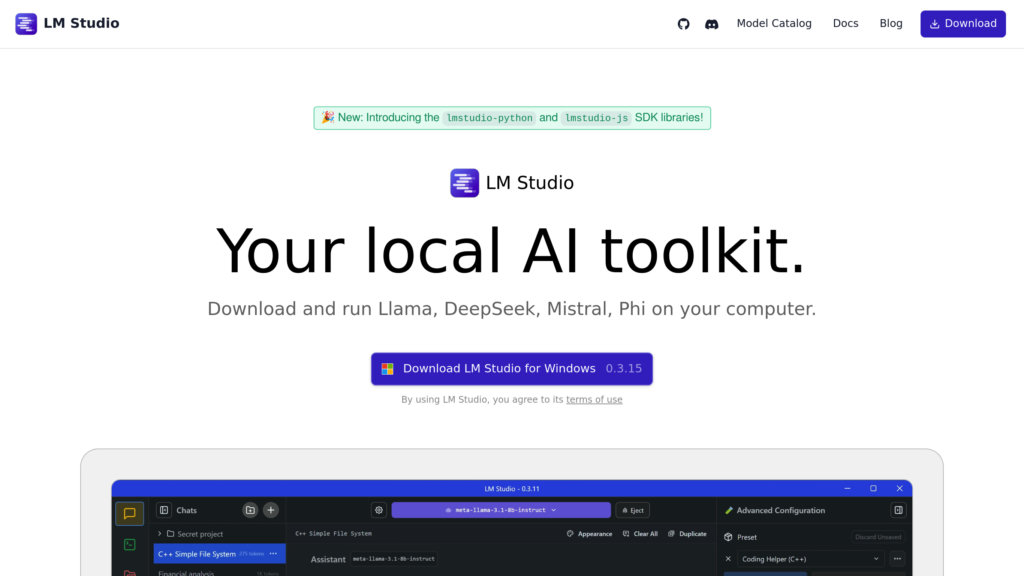

什么是LM Studio?

LM Studio是一款多功能桌面应用,专为在本地设备上运行和实验大语言模型而设计,无需依赖互联网。支持macOS、Windows和Linux平台,兼容llama.cpp、Apple的MLX等开源运行时,带来高效的模型执行体验。用户可从Hugging Face仓库浏览和下载丰富的LLM,通过类ChatGPT界面与模型互动,并可借助RAG实现离线文档交互等高级功能。LM Studio还提供OpenAI兼容的本地API服务器,便于与自定义应用和脚本无缝集成,确保数据隐私和AI工作负载的自主可控。

主要功能

本地LLM运行

在您的本地硬件上运行大语言模型,无需联网,保障数据隐私并支持离线访问。

模型发现与管理

可直接在应用内浏览、下载并加载来自 Hugging Face 的各种开源LLM模型。

聊天界面与文档交互

通过直观的聊天界面与模型互动,并利用RAG技术查询本地文档,实现增强的上下文理解。

OpenAI兼容API服务器

通过兼容OpenAI端点的REST API本地服务模型,便于与外部应用和脚本集成。

多平台支持

支持macOS(包括Apple Silicon)、Windows(x64/ARM64)和Linux,兼容llama.cpp、MLX等多种运行时。

高级自定义与开发者工具

提供CLI工具、SDK(包括Python)、开发者模式,并可灵活微调模型参数和工作流。

使用场景

- 注重隐私的AI研究 : 研究人员可在本地运行和实验LLM,无需将敏感数据上传至云端。

- 离线文档分析 : 用户可上传文档并在完全离线环境下通过AI进行交互,适用于安全数据场景。

- AI应用开发 : 开发者可利用本地模型和OpenAI兼容API进行AI应用的开发与测试。

- 定制化AI聊天机器人 : 创建基于内部数据、无外部依赖的聊天机器人,提升安全性与可控性。

- 模型实验与评估 : 在同一平台轻松探索和对比不同开源LLM,寻找最适合特定任务的模型。

常见问题

LM Studio的替代方案

Unsloth AI

开源平台,加速大语言模型微调,最高提升32倍速度并减少显存占用。

Cerebras

AI加速平台,通过晶圆级处理器和云端超级计算,带来深度学习、LLM训练与推理的突破性速度。

Llama 4

Meta推出的新一代开放权重多模态大语言模型,在文本、图像理解和超长上下文处理方面表现领先。

书生通用大模型

开源大语言模型系统,具备多模态理解、跨模态生成与全链路 AI 开发工具。

Nous Research

专注于开源、人本语言模型与去中心化 AI 基础设施的前沿 AI 研究集体。

Google Gemini

Google最先进的多模态AI模型套件,实现跨文本、图片、音频、视频和代码的无缝推理。

Ollama

本地推理引擎,支持用户在自有设备上运行和管理大语言模型(LLM),提升隐私保护、自定义和离线AI能力。

LM Arena (Chatbot Arena)

开源、社区驱动的大语言模型(LLM)实时基准测试与评测平台,采用众包成对对比和Elo评分体系。

LM Studio网站分析

🇺🇸 US: 16.54%

🇨🇳 CN: 10.96%

🇷🇺 RU: 6.26%

🇮🇳 IN: 5.98%

🇩🇪 DE: 5.34%

Others: 54.92%