产品概览

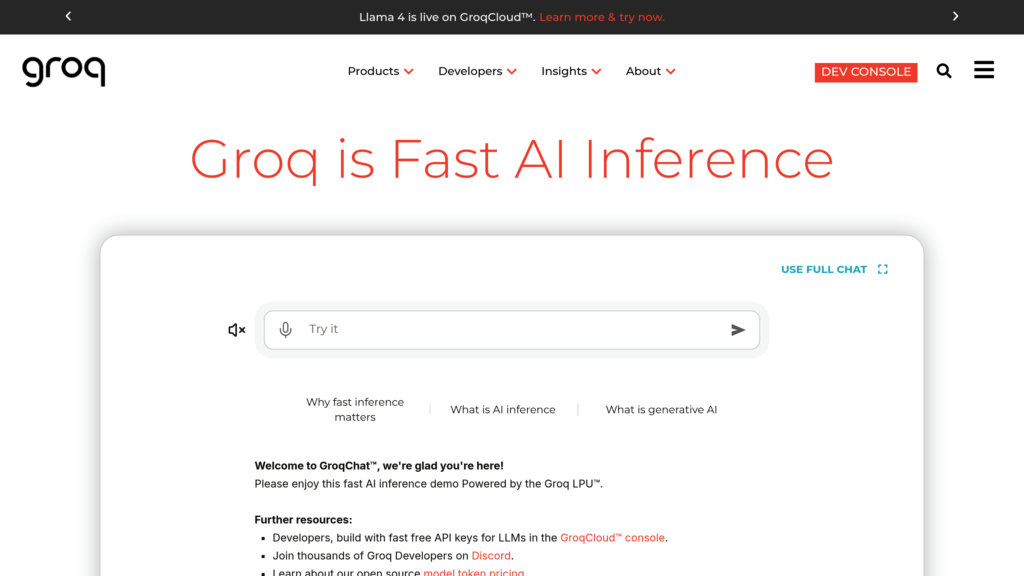

什么是Groq?

Groq是一家专注于AI加速的公司,通过其专有的语言处理单元(LPU)ASIC和GroqCloud、GroqRack等软件平台,提供卓越的AI推理速度与效率。Groq为开发者和企业提供无缝、低延迟的AI模型部署与执行,支持包括Llama、Whisper等在内的多种公开模型。其架构专注于最大化吞吐量并最小化延迟,非常适合科技、医疗、金融、汽车等行业的实时AI应用。Groq平台对开发者友好,提供兼容OpenAI的API和极简迁移流程,助力用户高效扩展AI工作负载并降低运维成本。

主要功能

专有LPU硬件

Groq的语言处理单元(LPU)是一款定制的AI加速芯片,针对张量流处理进行了优化,实现了无与伦比的AI推理速度和能效。

GroqCloud API平台

基于云的无服务器AI推理服务,通过兼容OpenAI的API,为用户提供可扩展的Groq硬件访问,实现便捷集成与部署。

无缝迁移

只需更改三行代码,即可轻松从其他AI服务商(如OpenAI)迁移,最大程度减少开发者阻力,加速应用落地。

支持主流AI模型

兼容多种公开可用的AI模型,如Llama、DeepSeek、Mixtral、Qwen和Whisper,支持多样化AI应用场景。

高扩展性与高效能

可随数据需求增长灵活扩展,同时优化能耗与运维成本,适用于企业及初创公司。

强大的安全性与合规性

实施了端到端加密等强有力的数据保护措施,并符合GDPR、SOC 2等合规标准。

使用场景

- 实时AI推理 : 为需要即时AI响应的应用场景提供支持,如对话智能体、推荐系统和自动驾驶决策。

- AI模型部署与测试 : 为AI开发者和研究人员提供高效部署、测试和扩展大语言模型及其他AI任务的能力。

- 电商AI助手 : 为消费者提供实时、数据驱动的商品推荐与研究支持,赋能AI购物助手。

- 医疗健康分析 : 以AI驱动的诊断、预测分析和患者数据管理,提供快速可靠的推理能力。

- 金融服务AI : 通过低延迟AI推理和可扩展基础设施,支持欺诈检测、风险评估和算法交易。

- 云端AI基础设施 : 为企业提供灵活的云端AI算力资源,无需管理硬件负担。

常见问题

Groq的替代方案

RunPod

专为AI工作负载优化的云计算平台,提供可扩展GPU资源,支持AI模型的训练、微调与部署。

Vast.ai

一个提供灵活定价、可扩展云端 GPU 租赁及便捷部署的 GPU 市场平台,专为 AI 及计算密集型工作负载设计。

LiteLLM

开源LLM网关,通过统一OpenAI兼容接口,提供对100+语言模型的标准化访问能力。

Jan

开源、注重隐私的 AI 助手,支持本地与云端模型,具备高度定制与离线能力。

Fluidstack

云平台提供快速、大规模的GPU基础设施,用于AI模型训练和推理,受到领先AI实验室和企业的信赖。

GMI Cloud

一个推理优先的GPU云平台,结合serverless推理和专用GPU基础设施,用于生产AI工作负载,基于NVIDIA硬件构建。

Cerebrium

无服务器AI基础设施平台,实现AI模型的快速、可扩展部署和管理,优化性能和成本效率。

FuriosaAI

专为数据中心中可扩展推理设计的高性能、低功耗AI加速器,针对大型语言模型和多模态工作负载进行优化。

Groq网站分析

🇮🇳 IN: 23.83%

🇺🇸 US: 12.76%

🇧🇷 BR: 7.57%

🇵🇰 PK: 3.4%

🇮🇩 ID: 3.37%

Others: 49.07%