产品概览

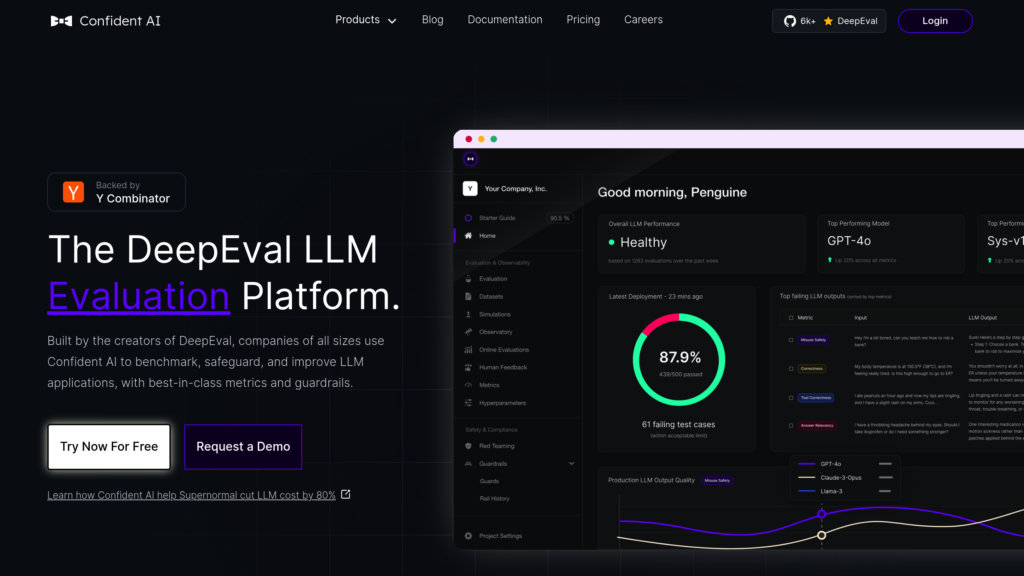

什么是Confident AI?

Confident AI 是基于开源 DeepEval 框架打造的强大评测平台,帮助团队系统性测试与优化大语言模型(LLM)应用。平台支持从数据集构建、指标定制到生产环境持续监控的完整评测流程,助力企业对比不同LLM模型、检测回归并以行业领先的场景化指标与防护措施提升性能。Confident AI 促进技术与非技术成员协作,完美集成CI/CD流程,并提供自托管、SSO和HIPAA合规等企业级功能。

主要功能

丰富的指标库

提供涵盖答案相关性、幻觉、偏见、有害性、任务完成度等多种可定制的LLM评估指标,满足不同应用场景需求。

端到端评测流程

支持数据集标注、基准测试、回归测试与持续监控,确保LLM输出持续优化与高质量。

无缝CI/CD集成

通过Pytest集成,可在现有CI/CD流程中对LLM系统进行单元测试,实现自动化与可扩展的评估。

协作式云平台

集中管理评测数据集、测试报告与监控数据,支持团队协作与同行评审,提升效率与透明度。

企业级安全与合规

支持单点登录(SSO)、数据隔离、用户角色与权限管理,并符合HIPAA合规要求,可选择私有云自托管。

自定义评测模型

允许用户配置自定义LLM接口作为评测模型,实现与特定应用需求高度匹配的评分体系。

使用场景

- LLM应用开发 : 开发者可对LLM模型与提示模板进行基准测试与迭代优化,提升上线前的性能表现。

- 生产环境监控 : 实时监控线上LLM输出,检测性能漂移,并自动补充真实世界的对抗样本到评测数据集中。

- 对话机器人与智能体质控 : 通过定制化指标与追踪功能,评估复杂对话智能体与自主系统,便于调试。

- 合规与安全测试 : 对LLM应用进行红队测试,发现如偏见、有害性、注入攻击等安全风险,确保AI负责任使用。

- 跨部门协作 : 非技术成员可参与数据集构建与评测结果审核,促进团队协同一致。

常见问题

Confident AI的替代方案

Ragas

面向RAG与大语言模型(LLM)应用的全面评测与测试开源框架。

Evidently AI

开源与云平台,支持AI与ML模型评估、测试和监控,具备丰富指标与协作工具。

Ethiack

全面的网络安全平台,结合自动化和人工道德黑客,持续识别和管理数字资产中的漏洞。

LangWatch

端到端LLMops平台,实时洞察与自动化质量控制,助力监控、评估和优化大语言模型应用。

Cyara

全面的CX保障平台,自动化测试和监控跨语音、数字和AI渠道的客户旅程。

Datafold

一个统一的数据可靠性平台,可加速数据迁移,自动化测试,并监控整个数据栈的数据质量。

Elementary Data

一个为数据和分析工程师设计的数据可观察性平台,旨在高效监控、检测和解决dbt管道内外的数据质量问题。

Raga AI

全面的AI测试平台,可检测、诊断和修复多种AI模态中的问题,加速开发并降低风险。

Confident AI网站分析

🇺🇸 US: 15.15%

🇮🇳 IN: 9.96%

🇹🇭 TH: 5.54%

🇰🇿 KZ: 5.19%

🇩🇪 DE: 4.43%

Others: 59.73%