LM Arena (Chatbot Arena)

開源、社群驅動的大型語言模型(LLM)即時基準評測平台,透過群眾對比與 Elo 排名進行評分。

產品概覽

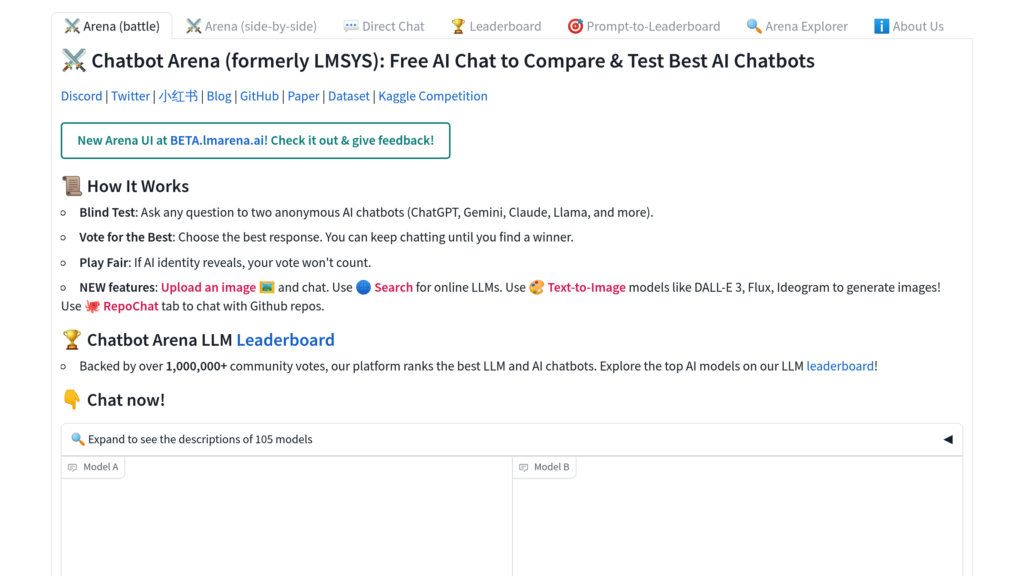

LM Arena (Chatbot Arena) 是什麼?

LM Arena(又稱 Chatbot Arena)是由 LMSYS 與 UC Berkeley SkyLab 共同開發的開源平台,致力於透過即時、透明且社群驅動的評測推動大型語言模型(LLM)的發展與理解。用戶可匿名與多個 LLM 互動並進行對比投票,平台利用 Elo 排名系統根據投票結果為模型排名。支援多種公開模型(包含開放權重與商業 API),排行榜會根據用戶回饋持續更新。LM Arena 強調透明、開放科學與協作,並於 GitHub 公開資料集、評測工具及基礎架構。

主要功能

群眾協作的模型對比

使用者可參與匿名、隨機的兩個大型語言模型(LLM)對戰,投票選出較佳回應,產生可靠的比較數據。

Elo 排名系統

採用廣為人知的 Elo 排名系統,為 LLM 提供動態且統計嚴謹的表現排名。

開源基礎架構

平台所有組件(包含前端、後端、評測流程與排名演算法)皆為開源,並公開提供。

即時且持續評測

即時收集用戶提問與投票,確保評測結果能反映現有模型能力與真實使用情境。

支援公開模型

納入開放權重、API 介接或服務型態公開的模型,確保透明與可重現性。

社群參與與透明度

鼓勵廣泛參與,並公開用戶偏好數據與提問,促進協作式 AI 研究。

使用案例

- LLM 效能基準測試 : 研究人員與開發者可在真實情境下評估與比較不同大型語言模型的效能。

- 模型部署選擇 : 企業可根據即時社群排名,挑選最適合自身應用的 LLM。

- 開放科學與研究 : 學術界與 AI 從業者可使用共享資料集與工具,進行可重現的研究並推進模型開發。

- 社群回饋促進模型優化 : 模型提供者可蒐集匿名用戶回饋與投票數據,於正式發布前優化自家 AI 系統。

常見問題

LM Arena (Chatbot Arena) 的替代方案

RunPod

專為 AI 工作負載優化的雲端運算平台,提供可擴展 GPU 資源,支援 AI 模型訓練、微調與部署。

Geekbench

跨平台效能測試工具,評量各類裝置與作業系統的 CPU 與 GPU 效能。

MiroMind

一個利用開源模型進行深度資料分析、網路搜尋和程式碼生成的研究助手。

Sakana AI

總部位於東京的 AI 研究公司,領先開發仿生基礎模型與全自動 AI 科學研究。

无问芯穹

企業級異構計算平台,實現大型模型在多樣化晶片架構上的高效部署。

Userbrain

無主持遠端使用者測試平台,透過全球測試員池和自動化分析工具簡化UX研究。

Ballpark

一站式用戶研究平台,透過多元測試方式與豐富媒體回饋,輕鬆蒐集產品構想、行銷文案、設計與原型的高品質意見。

MindSpore

全場景、開源深度學習框架,易於開發、高效執行,並可於雲端、邊緣與裝置環境統一部署。

LM Arena (Chatbot Arena) 網站分析

🇨🇳 CN: 61.35%

🇷🇺 RU: 5.58%

🇸🇳 SN: 2.97%

🇺🇸 US: 2.34%

🇮🇳 IN: 1.69%

Others: 26.06%