LM Arena (Chatbot Arena)

クラウドソースによるペアワイズ比較とEloレーティングを用いた、大規模言語モデル(LLM)のライブベンチマークと評価のためのオープンソース・コミュニティ主導型プラットフォーム。

製品概要

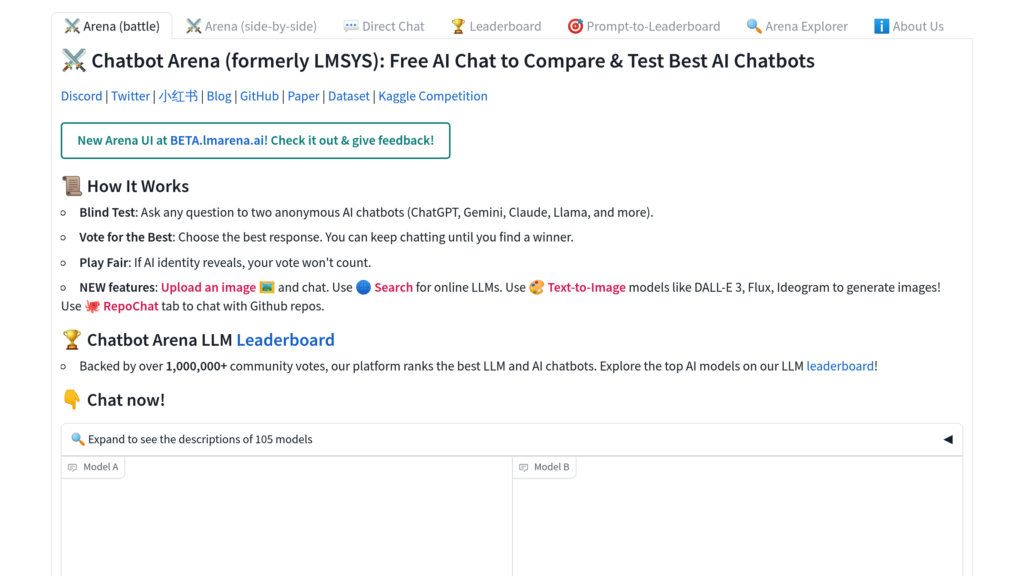

LM Arena (Chatbot Arena)とは?

LM Arena(Chatbot Arena)は、LMSYSおよびUC Berkeley SkyLabによって開発されたオープンソースプラットフォームであり、大規模言語モデルの発展と理解を促進するために、ライブ・透明性・コミュニティ主導の評価を実現します。ユーザーは複数のLLMを匿名バトル形式で比較し、投票によってEloレーティングでモデルをランキングします。プラットフォームはオープンウェイトおよび商用APIを含む幅広い公開モデルをサポートし、実際のユーザーフィードバックに基づいてリーダーボードを継続的に更新します。LM Arenaは、透明性・オープンサイエンス・協調を重視し、データセット・評価ツール・インフラストラクチャをGitHubでオープンに共有しています。

主な機能

クラウドソースによるペアワイズモデル比較

ユーザーは2つのLLMによる匿名かつランダムなバトルに参加し、優れた応答に投票することで信頼性の高い比較データを生成します。

モデルランキングのためのEloレーティングシステム

広く認知されているEloレーティングシステムを採用し、LLMパフォーマンスの動的かつ統計的に信頼できるランキングを提供します。

オープンソースインフラストラクチャ

フロントエンド、バックエンド、評価パイプライン、ランキングアルゴリズムなど、すべてのプラットフォームコンポーネントがオープンソースとして公開されています。

ライブかつ継続的な評価

ユーザーのプロンプトと投票をリアルタイムで収集し、現行モデルの能力や実際のユースケースを反映した最新のベンチマークを実現します。

公開モデルのサポート

オープンウェイトやAPI経由でアクセス可能なモデル、サービスとして利用できるモデルを含み、透明性と再現性を確保します。

コミュニティ参加と透明性

幅広い参加を促し、ユーザーの選好データやプロンプトをオープンに共有することで、協調的なAI研究を推進します。

ユースケース

- LLMパフォーマンスのベンチマーク : 研究者や開発者は、さまざまな大規模言語モデルの有効性を実環境下で評価・比較できます。

- デプロイメントのためのモデル選定 : 組織は、ライブのコミュニティ主導ランキングを参考にして、用途に最適なLLMを選定できます。

- オープンサイエンスと研究 : 学術関係者やAI実務者は、共有データセットやツールを活用して再現性のある研究やモデル開発を進めることができます。

- モデル改善のためのコミュニティフィードバック : モデル提供者は、匿名化されたユーザーフィードバックや投票データを収集し、正式リリース前にAIシステムを改良できます。

よくある質問

LM Arena (Chatbot Arena)の代替品

RunPod

AIワークロードに最適化されたクラウドコンピューティングプラットフォームであり、AIモデルの学習・ファインチューニング・デプロイのためのスケーラブルなGPUリソースを提供します。

Geekbench

さまざまなデバイスとOS間でCPUとGPUの性能を測定するクロスプラットフォームベンチマークツールです。

MiroMind

オープンソースモデルを活用した深度データ分析、Web検索、コード生成のための研究アシスタント。

Sakana AI

東京拠点のAI研究企業。自然界に着想を得たファウンデーションモデルと完全自動化AI科学発見を先駆けて開発。

Ballpark

アイデア、マーケティングコピー、デザイン、プロトタイプに対する高品質なフィードバックを多様なテスト方法とリッチメディアで簡単に取得できるユーザーリサーチプラットフォーム。

Userbrain

グローバルテスタープールと自動化分析ツールを通じてUXリサーチを合理化する無司会リモートユーザーテストプラットフォーム。

MindSpore

クラウド・エッジ・デバイス環境での容易な開発・効率的な実行・統一デプロイを実現する全シナリオ対応のオープンソースディープラーニングフレームワークです。

LAION

アクセス可能で持続可能な機械学習研究をサポートするための広大なオープンデータセット、モデル、ツールを提供する非営利団体です。

LM Arena (Chatbot Arena)ウェブサイトの分析

🇨🇳 CN: 57.85%

🇷🇺 RU: 3.5%

🇮🇳 IN: 2.72%

🇸🇳 SN: 2.29%

🇺🇸 US: 1.66%

Others: 31.97%